الذكاء الاصطناعي

قيود صارمة على موظفي DeepSeek وسط تشديد الرقابة في الصين

الذكاء الاصطناعي

الذكاء الاصطناعي يُعيد تشكيل مستقبل الغذاء سلامة أعلى وتغذية مخصصة وجودة محسّنة

تطبيقات وبرامج

Perplexity نجمة الذكاء الاصطناعي التي تُغري عمالقة التكنولوجيا بالاستحواذ

تطبيقات وبرامج

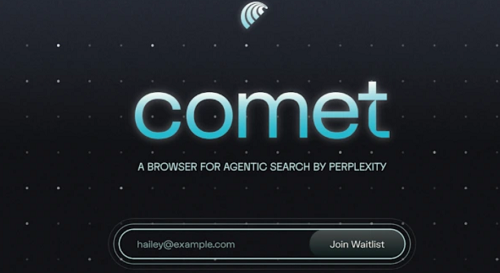

Comet أول متصفح ذكاء اصطناعي بلا إعلانات من شركة Perplexity

-

تطبيقات وبرامج6 أيام ago

سدايا تطلق برنامجًا وطنيًا لتصنيف البيانات خطوة استراتيجية نحو حوكمة فعالة وتعزيز الكفاءات

-

أخبار تقنية6 أيام ago

ميتا تُحذر من مشاركة البيانات الحساسة في تطبيق Meta AI بعد موجة انتقادات

-

أجهزة محمولة6 أيام ago

macOS Tahoe مقابل macOS Sequoia من يتفوق في الذكاء والتصميم وهل التحديث ضروري

-

أخبار الألعاب5 أيام ago

ستيم يرفع مستوى تتبع الأداء داخل الألعاب تحديث شامل بتقنيات جديدة

-

أخبار تقنية6 أيام ago

حرب التكنولوجيا تشتعل جوجل تسخر من آبل وتتهمها بتقليد ميزات هواتف بكسل

-

أخبار تقنية5 أيام ago

سبوتيفاي تستعد لإطلاق ميزة HiFi نقلة نوعية في جودة الصوت قريبة

-

الذكاء الاصطناعي6 أيام ago

OpenAI تتعاون مع البنتاغون في عقد ضخم لتطوير تقنيات ذكاء اصطناعي دفاعية

-

أخبار تقنية5 أيام ago

خلل برمجي من مايكروسوفت يعطّل متصفح كروم على نظام ويندوز